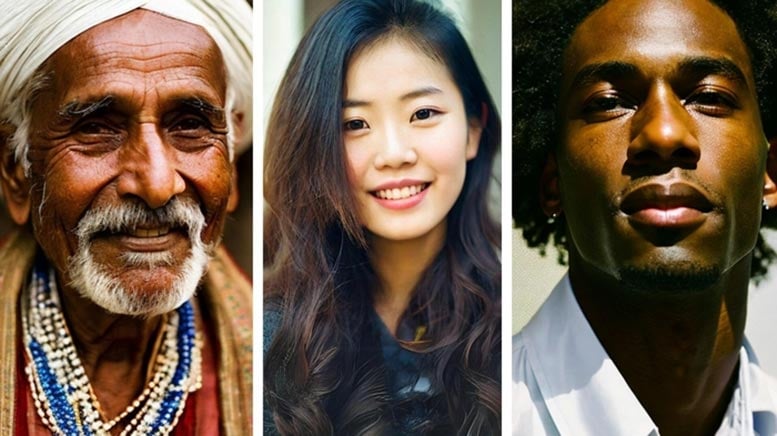

وجدت دراسة أجرتها جامعة واترلو أن الناس يجدون صعوبة في التمييز بين الصور الحقيقية والصور المولدة بواسطة الذكاء الاصطناعي، بدقة تصل إلى 61% فقط، مما يثير مخاوف بشأن موثوقية المعلومات المرئية والحاجة إلى أدوات لتحديد المحتوى الناتج عن الذكاء الاصطناعي. الائتمان: SciTechDaily.com

تظهر الأبحاث أن المشاركين في الاستطلاع قد تم خداعهم بواسطة الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي بنسبة 40 بالمائة تقريبًا من الوقت.

إذا واجهت مؤخرًا مشكلة في معرفة ما إذا كانت صورة الشخص حقيقية أو تم إنشاؤها من خلال الذكاء الاصطناعي (AI)، فأنت لست وحدك.

وجدت دراسة جديدة أجراها باحثون من University of Waterlooجامعة واترلو أن الناس واجهوا صعوبة أكبر مما كان متوقعًا في التمييز بين الشخص الحقيقي والشخص المصطنع.

شهدت دراسة واترلو تزويد 260 مشاركًا بـ 20 صورة غير مصنفة: 10 منها لأشخاص حقيقيين تم الحصول عليها من عمليات بحث Google، والعشر الأخرى تم إنشاؤها بواسطة Stable Diffusion أو DALL-E، وهما برنامجان شائعان للذكاء الاصطناعي يقومان بإنشاء الصور.

طُلب من المشاركين تصنيف كل صورة على أنها حقيقية أو تم إنشاؤها بواسطة الذكاء الاصطناعي وشرح سبب اتخاذهم لقرارهم. ولم يتمكن سوى 61% من المشاركين من التمييز بين الأشخاص الذين أنشأهم الذكاء الاصطناعي والأشخاص الحقيقيين، وهي نسبة أقل بكثير من عتبة 85% التي توقعها الباحثون.

ثلاث من الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي المستخدمة في الدراسة. الائتمان: جامعة واترلو

المؤشرات المضللة والتطور السريع للذكاء الاصطناعي

وقالت أندريا بوكول، طالبة الدكتوراه في علوم الكمبيوتر بجامعة واترلو والمؤلفة الرئيسية للدراسة: "الناس ليسوا ماهرين في التمييز كما يعتقدون".اهتم المشاركون بالتفاصيل مثل الأصابع والأسنان والعينين كمؤشرات محتملة عند البحث عن محتوى تم إنشاؤه بواسطة الذكاء الاصطناعي - لكن تقييماتهم لم تكن صحيحة دائمًا.

وأشار بوكول إلى أن طبيعة الدراسة سمحت للمشاركين بفحص الصور بشكل مطول، في حين أن معظم مستخدمي الإنترنت ينظرون إلى الصور بشكل عابر.

وقال بوكول: "الأشخاص الذين لا يملكون الوقت الكافي أو الذين لا يملكون الوقت الكافي لن يلتقطوا هذه الإشارات".

وأضاف بوكول أن المعدل السريع للغاية الذي تتطور به تكنولوجيا الذكاء الاصطناعي يجعل من الصعب بشكل خاص فهم احتمالات الأعمال الخبيثة أو الشائنة التي تشكلها الصور المولدة بواسطة الذكاء الاصطناعي. غالبًا ما لا تكون وتيرة البحث الأكاديمي والتشريعات قادرة على مواكبة ذلك: أصبحت الصور المولدة بواسطة الذكاء الاصطناعي أكثر واقعية منذ بدء الدراسة في أواخر عام 2022.

تهديد المعلومات المضللة الناتجة عن الذكاء الاصطناعي

تشكل هذه الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي تهديدًا بشكل خاص كأداة سياسية وثقافية، حيث يمكن لأي مستخدم إنشاء صور مزيفة لشخصيات عامة في مواقف محرجة أو مساومة.وقال بوكول: "إن المعلومات المضللة ليست جديدة، لكن أدوات التضليل تتغير وتتطور باستمرار". "قد يصل الأمر إلى نقطة حيث سيظل الناس، بغض النظر عن مدى تدريبهم، يكافحون من أجل التمييز بين الصور الحقيقية والمزيفة. ولهذا السبب نحتاج إلى تطوير أدوات لتحديد هذا الأمر ومواجهته. إنه مثل سباق تسلح جديد للذكاء الاصطناعي”.

نُشرت الدراسة التي تحمل عنوان "الرؤية لم تعد تصدق: دراسة استقصائية عن حالة التزييف العميق والبشر الذين ينتجهم الذكاء الاصطناعي والوسائط الأخرى غير المؤكدة"، في مجلة Advances in Computer Graphics .